Imagen: Bing Creator (DALL-E3)

- Generan un contenido a partir del trabajo de otros autores sin tener en cuenta la autoría.

- Dicho contenido generado por la IA a partir de material original humano, está siendo reutilizado de nuevo por la IA sin distinguir unos de otros, distorsionando el resultado y obligando a los proveedores y buscadores a etiquetar el contenido para poder realizar dicha diferenciación.

- Para alimentar los algoritmos de IA con modelos adecuados, es necesario un «ejército» de trabajadores mal pagados para realizar tareas de corrección de todo aquello que ha de ser revisado —incluyendo pornografía y mutilaciones—

Ahora bien, ese «largo camino» que queda por recorrer implica que la IA todavía puede mejorarse mucho. Esto no ha acabado aquí, aunque de momento, se puede reflexionar sobre lo que llevamos.

El atrevimiento de la ignorancia

El dicho popular señala que suele presumir aquel que menos tiene para hacerlo. También, que el que permanece más calmado es el que menos sabe lo que pasa. Y por último, está el atrevimiento del ignorante. Esos sesgos están contemplados en un concepto llamado efecto Dunning-Kruger, por el cuál las personas de bajo desempeño tienden a sobrestimarse, es decir, son menos capaces para la autocrítica, precisamente por dicha carencia. Una IA puede parecer cualquier cosa menos carente de desempeño, sin embargo, para poder autoevaluarse —para poder dar una medida estimada del posible error de sus respuestas— es necesario poseer alguna consciencia de este. Es necesario «saber» que no lo sabes todo, que «hay más ahí fuera». Una IA asume que todo lo que existe es lo que tiene en su memoria, no tiene manera de considerar lo que no tiene. Aunque la IA se asume que aprende, lo hace a partir de un modelo y de los datos con los que se la alimenta, pero no tiene en cuenta lo que no se le está ofreciendo. Por tanto, una IA no tiene medida alguna de sus errores. Se limita a ofrecer de forma genérica advertencias para que revisemos los datos en algunos casos, como los avisos de los medicamentos para mantener fuera del alcance de los niños.

«Su defecto más profundo es la ausencia de la capacidad más crítica que posee cualquier inteligencia: decir no solo lo que ocurre, lo que ocurrió y lo que ocurrirá, sino también lo que no ocurre y lo que podría y no podría ocurrir»

—Noam Chomsky, lingüista y experto en ciencia cognitiva (enlace)

Errar es de humanos

El ser humano es falible por naturaleza. No somos «perfectos». Debido precisamente a nuestros prejuicios, se suele considerar nuestra condición despectivamente como algo defectuoso, sujeto a disonancias de todo tipo. Sin embargo, un análisis algo más objetivo nos advierte que esto es sencillamente inevitable. En verdad, el ser humano es una entidad que funciona bastante bien la mayoría de las veces, adaptándose a circunstancias muy volátiles y diversas. Pretender cierto grado de perfección es probablemente aberrante. Esta no existe más que en acotados diseños teóricos —como los de una IA—. Por tanto, nuestra inevitable y a veces molesta falibilidad, probablemente sea nuestra principal característica que nos diferencie frente a ella. Pero no en sentido negativo por el fallo en sí mismo, sino por la capacidad que nos proporciona ser conscientes de nuestro alejamiento de ese ideal que solo existe en nuestra imaginación. Un motor y reflejo de nuestra creatividad, tan simple para nosotros pero tan complicado para una IA.

«la respuesta escapaba a mi comprensión porque requería de una mente inferior, o quizá menos limitada por los parámetros de la perfección»

—El Arquitecto (Matrix Reloaded —Wachowsy's)

|

|

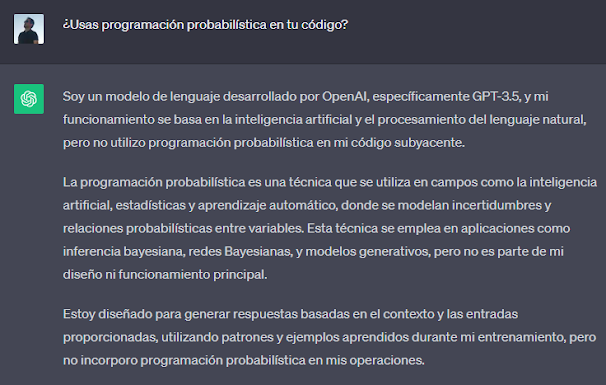

| Respuesta proporcionada por las IA de OpenAI 'ChatGPT' y Google 'Bard' a la pregunta de si usan programación probabilística en su código —no las usan— |

Existen varios casos y estudios que apoyan esta visión. En el 2018 Google y Uber, introdujeron modelos de programación probabilísticos para mejorar sus algoritmos de predicción. Es decir, aplicaron un factor de error —al menos, un grado de incertidumbre— para mejorar su modelo, lo que no deja de resultar paradójico. Desde entonces el único inconveniente que parece que tengan estos paradigmas probabilísticos son los elevados requerimientos de computación. A día de hoy no parece que se haya llegado a una solución definitiva, evidenciando que las posibles mejoras parece que se encuentran en el ámbito de cómo la IA maneja la incertidumbre.

«mientras una inteligencia no demuestre ese punto de duda e inseguridad, ansiedad ante la posibilidad del fracaso y la capacidad de adaptar según las circunstancias el grado de éxito respecto al objetivo original, no habrá realmente inteligencia»

—F. J. Suñer Iglesias (El Sitio de ciencia-ficción)

De manera paralela, en el otro lado de esta ecuación se encuentran los estudios sobre la consciencia humana y qué hace hace a nuestra inteligencia tan particular y distinta de la artificial. Precisamente, varios estudios concuerdan que es el carácter probabilístico de la mecánica cuántica la que mejor podría explicar cómo funciona nuestra mente y una de las conclusiones más llamativas es que la principal característica que nos define es la de cometer errores. En definitiva, tanto para mejorar la inteligencia artificial en si misma, como para hacerlo con la interacción de esta con los humanos, es necesario contemplar el error como parte de un proceso de interacción con el mundo real. Un mundo de probabilidades donde las cosas no siempre salen como queremos. Un mundo en el que la humanidad ha tenido que aprender a vivir, convencidos de una seguridad como manera de hacer frente a la incertidumbre que no deseamos aceptar del todo, pero que en el fondo sabemos que está ahí. Unos humanos que a pesar de sus tropiezos y errores, hemos sabido aprovecharlos y aprender de ellos, para lograr llegar hasta donde estamos.

Enlaces

- Rubio, Isabel. La creación de la World Wide Web fue un accidente. (17/05/2020). Noticias & Protagonistas (publicado originalmente en El País) [acceso el 25/10/2023] <enlace>

- Green, Tristan. Quantum cognition theory explains why humans make stupid decisions (20/01/2020). The Next Web. [acceso el 25/10/2023] <enlace>

- Niel, David. Here's Why Our Most Irrational Decisions Could Be a Result of Quantum Theory. (17/09/2015). Science Alert. [acceso el 25/10/2023] <enlace>

3 comments:

Es curioso leer citas propias. Es como encontrarte con tu yo del pasado, y desconcertante por como es posible que los procesos mentales hayan cambiando tan sutilmente, hasta el punto que al primer vistazo no tengas ni puñetera idea que querías expresar exactamente. Pero na, he tardado cero coma en sincronizar líneas de pensamiento.

Por extenderme: una de las características de la inteligencia es que, más allá de buscar múltiples caminos hasta lograr el objetivo marcado, puede alterar autónomamente ese objetivo si, tras la búsqueda, se concluye que es imposible alcanzarlo en su forma original.

Hola fjsi. Lo que comentas viene a ser una técnica de programación llamada 'backtracking' que es similar a la programación probabilística aunque con menos alcance. Pero eso no es lo que se intenta comentar en el artículo y lo que entendía cuando leí el tuyo hace ya unos años —lo que viene a demostrar también que los actuales debates eran "normales" en el ámbito de la ciencia-ficción desde hace tiempo—.

A los humanos no nos hace falta recorrer uno por uno todos los posibles caminos alternativos para entender que el camino elegido inicialmente es solo uno de ellos. Por otro lado, a un algoritmo hay que especificarle previamente qué clase de variaciones tiene que tomar. Es decir, el ámbito de posibles caminos alternativos ha de estar previamente definido de alguna manera. El algoritmo lo que hace es tomar uno de ellos considerado el más probable, y en función del resultado decidir si ha de tomar otro.

Pero los humanos nos tenemos que enfrentar a problemas estocásticos que no pueden ser definidos de esta manera, o bien, el número de posibles alternativas es inmanejable, por lo que hay que efectuar un filtrado "probabilístico", estos es, manejar el error y la incertidumbre. Algo que los humanos hacemos todos los días, y la IA apenas sabe hacer .

😉

Hola. Acabo de releer los comentarios y me he dado cuenta de que probablemente estábamos hablando de lo mismo, pero en efecto, he cometido un "error" de interpretación del cuál he sido ahora consciente 😉.

Sí, lo que definiría a la inteligencia como tal es la capacidad de "darse" cuenta de la imposibilidad de alcanzar su meta, al menos en un sentido preciso y poder manejar los diferentes grados de error o de desviación, sin que se produzca un "system failure" 😄.

Publicar un comentario

Deje por favor al menos un nickname, apodo o alias. Pulse la opción «Nombre/URL», si no tiene cuenta en ninguna de las opciones que blogger le ofrece. Si su solicitud no es respondida al primer intento ¡no se preocupe! inténtelo de nuevo por favor. Gracias.

Lino (Al final de la Eternidad)

(elfindelaeternidadblog@gmail.com)

(Seguir al autor en Twitter)

[Dejar un comentario con el formulario clásico...]